Juristes : et si les US pouvaient accéder aux données confidentielles de vos clients ?

Est-ce que les autorités américaines peuvent accéder aux données confidentielles de vos clients ? C’est la question que de nombreux juristes européens se posent. Et la réponse n’est pas rassurante.

L’IA générative transforme le quotidien des professionnels du droit. Résumer un contrat en 30 millisecondes. Extraire les clauses clés d’un bail. Préparer une note de synthèse en quelques minutes. Les gains de temps sont réels et considérables.

Pourtant, cette adoption massive se fait souvent sans cadre. Le Thomson Reuters Institute le confirme dans son rapport 2025 : l’usage de l’IA chez les professionnels du droit a doublé en un an. Il est passé de 14% à 26% des organisations. Et 95% estiment que l’IA sera centrale d’ici 5 ans (voire 3 ans, c’est à dire demain…).

Or, dans le même temps, 78% de ces organisations n’ont toujours pas de stratégie formelle. Pas de politique interne. Pas de cadre pour les équipes. Pas de vérification des outils utilisés, ni de connaissance précise de la manière dont cela fonctionne et des enjeux à anticiper dès à présent pour une utilisation rationnelle et efficiente.

Ce décalage crée un terrain à risques. Particulièrement pour les professions soumises au secret professionnel, à une déontologie.

Cet article passe en revue 5 risques concrets afin d’aider les professionnels du droit et du chiffre, traitant des informations soumises au secret et/ou à la confidentialité à faire des choix éclairés.

Risque #1 — Vos données clients peuvent entraîner le modèle d’IA

C’est le risque le plus immédiat. Et le moins visible.

Lorsqu’un juriste utilise une offre grand public d’IA et souvent gratuite, les données partagées peuvent alimenter le modèle. Le contrat analysé contribue alors à améliorer l’IA pour tous les utilisateurs. Y compris des tiers et des concurrents potentiels.

Ce que font les trois principaux fournisseurs

Chaque fournisseur applique des règles différentes selon l’offre souscrite. Et tout change très vite — ce qui est vrai aujourd’hui peut évoluer demain.

→ ChatGPT (OpenAI) utilise vos données par défaut sur les offres Free, Plus et Team. Un paramètre permet de désactiver cette option. Mais cette protection repose sur une action volontaire de chaque utilisateur.

→ Claude (Anthropic) a évolué vers un système d’activation manuel depuis septembre 2025. C’est une amélioration. Cependant, si un collaborateur accepte par mégarde, la rétention des données passe de 30 jours à 5 ans. Par ailleurs, certaines conversations signalées par les classificateurs de sécurité (en clair un accès à vos données par un analyste) ne sont pas soumises à votre opt-out et sont conservés sept ans.

→ Le Chat Pro (Mistral AI) ne fait pas d’entraînement. C’est l’exception côté offres grand public. La version gratuite applique des conditions différentes.

Ce que ça signifie pour le secret professionnel

Un contrat client n’est pas une requête anodine. Il contient des informations personnelles, stratégiques et confidentielles. Si ces données alimentent un modèle, le juriste perd tout contrôle sur leur utilisation future.

La question à se poser est simple : mon outil garantit-il contractuellement que mes données ne servent pas à l’entraînement ? Un simple paramètre à activer ne suffit pas.

Risque #2 — L’absence de contrat de traitement de données (DPA)

Le DPA est le document clé. Il encadre juridiquement ce que le fournisseur fait de vos données. L’article 28 du RGPD l’exige pour tout traitement de données personnelles.

Le piège des noms commerciaux

Les noms des offres d’IA sont trompeurs. « Plus », « Pro », « Team » évoquent un usage professionnel. En réalité, ce sont des offres grand public.

Aucune de ces offres ne propose de DPA conforme au RGPD :

→ ChatGPT Plus (20$/mois) : pas de DPA.

→ ChatGPT Team : pas de DPA.

→ Claude Pro (20$/mois) : pas de DPA.

→ Claude Team : pas de DPA.

→ Mistral Le Chat Pro (14,99€/mois) : pas de DPA complet.

En synthèse, ces offres payantes font transiter vos données dans leur pays d’origine, à savoir les US pour OpenAI (ChatGPT) et Anthropic (Claude), l’Europe pour Mistral.

Les offres qui intègrent un vrai DPA sont uniquement les offres Enterprise ou API. Chez tous les fournisseurs sans exception. Leur coût démarre à plusieurs centaines d’euros par mois et par utilisateur.

Quelles conséquences concrètes ?

Sans DPA, aucune obligation contractuelle n’encadre le traitement de vos données. Pas de limitation d’usage. Pas de droit d’audit. Pas d’engagement de confidentialité formalisé.

En cas de contrôle de la CNIL ou de plainte d’un client, le professionnel ne peut pas démontrer sa conformité. Le prix payé n’y change rien.

La vérification est rapide : demandez le DPA à votre fournisseur. S’il n’existe pas, vous n’êtes pas conforme.

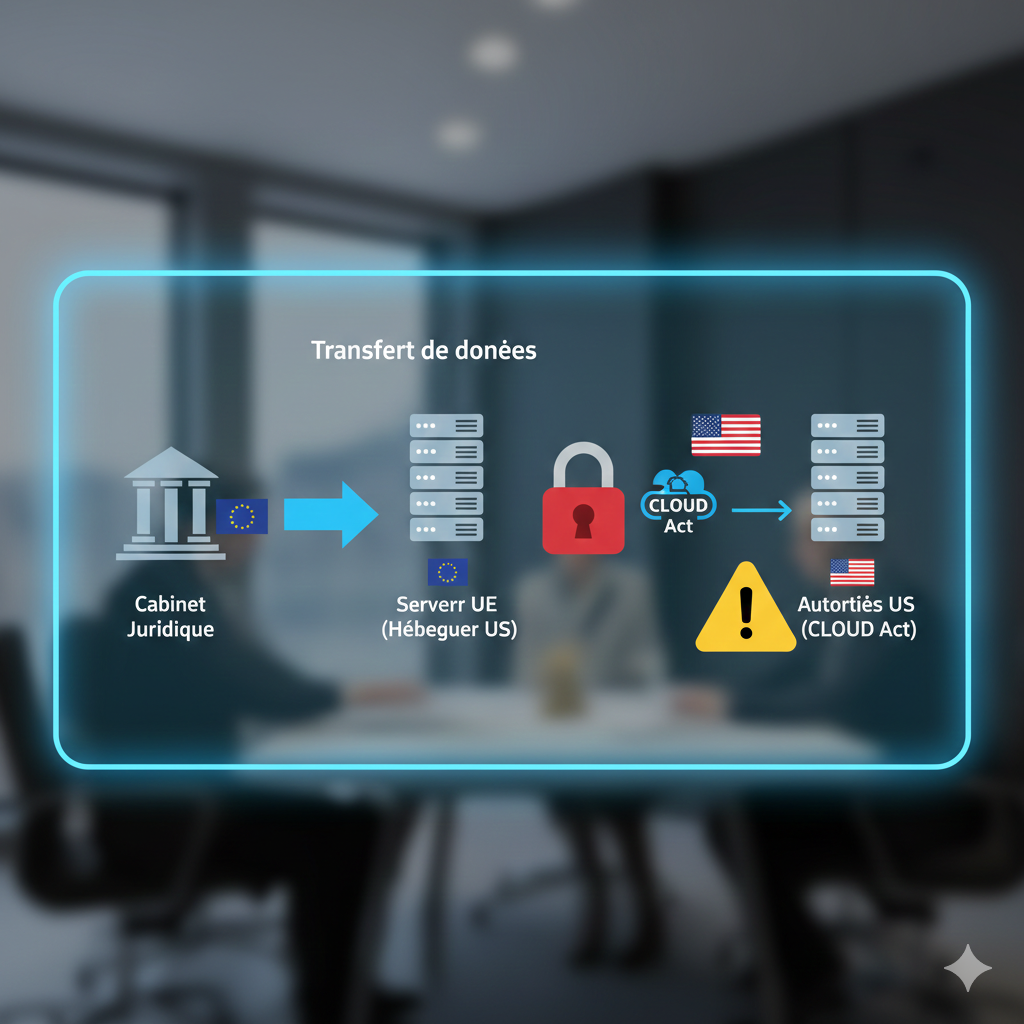

Risque #3 — Le CLOUD Act : les autorités US peuvent accéder à vos données… et ce n’est que le début

C’est la question que de plus en plus de juristes européens se posent : est-ce que les autorités américaines peuvent lire les données confidentielles des clients ?

La réponse juridique est claire. Le CLOUD Act est une loi fédérale américaine adoptée en 2018. Elle autorise les autorités US à exiger l’accès aux données de toute entreprise de droit américain. Cette obligation s’applique quel que soit le lieu de stockage des données.

Vos contrats sont sur un serveur à Paris ? Si le fournisseur est américain, le CLOUD Act s’applique quand même.

Un conflit frontal avec le RGPD

L’article 48 du RGPD est sans ambiguïté. Les transferts de données vers des pays tiers nécessitent un accord international. Le CLOUD Act n’en est pas un. Il contourne les traités d’entraide judiciaire traditionnels.

En décembre 2025, un rapport juridique de l’université de Cologne — établi pour le ministère allemand de l’Intérieur — a confirmé cette analyse. Le CLOUD Act, combiné au FISA prolongé jusqu’en avril 2026, permet aux agences US d’accéder à toute donnée hébergée par une entreprise américaine. Partout dans le monde.

La CNIL alerte régulièrement : pour les données sensibles, il faut garantir la protection contre toute divulgation à des autorités de pays tiers.

Où en sont les fournisseurs d’IA ?

| Fournisseur | Pays | CLOUD Act | Hébergement (grand public) |

|---|---|---|---|

| ChatGPT (OpenAI) | 🇺🇸 États-Unis | Oui | États-Unis |

| Claude (Anthropic) | 🇺🇸 États-Unis | Oui | États-Unis |

| Mistral AI | 🇫🇷 France | Non | Union Européenne |

Sur les offres Enterprise, ChatGPT et Claude proposent un hébergement UE via Azure ou AWS. Mais le CLOUD Act reste applicable. L’entreprise mère est américaine.

Seul Mistral AI, société française de droit français, échappe totalement à cette juridiction extra-territoriale, mais son modèle est considéré encore par certains comme moins performant.

L’enjeu déontologique

Pour un avocat tenu au secret professionnel, la question n’est pas : « est-ce que quelqu’un va effectivement lire mon contrat ? »

La question est : « suis-je en mesure de garantir à mon client que personne d’autre n’y a accès ? »

Avec un fournisseur soumis au CLOUD Act, cette garantie est juridiquement impossible à donner.

Déjà aux Etats-unis, une décision de justice vient de considérer que les échanges entre un avocat et le LLM n’étaient pas soumis au secret professionnel, et donc pouvaient être consultés !

Risque #4 — Le Shadow IT : vos équipes utilisent déjà l’IA sans cadre

Ce risque est le plus sous-estimé par les dirigeants de cabinet et les directions juridiques.

Le Shadow IT désigne l’utilisation d’outils par les collaborateurs sans validation de l’organisation. Dans le contexte de l’IA, c’est un phénomène massif.

L’écart entre adoption et encadrement

Les chiffres du Thomson Reuters Institute (2025) parlent d’eux-mêmes. Un juriste sur quatre utilise désormais l’IA. Mais quatre organisations sur cinq n’ont défini aucun cadre.

Concrètement : des collaborateurs traitent des dossiers clients dans des outils gratuits. Avec l’entraînement activé par défaut. Sans DPA. Sur des serveurs américains. Et la direction n’en sait rien.

Interdire n’est pas la solution

Bloquer l’accès à l’IA est contre-productif. Les collaborateurs contourneront l’interdiction avec leurs téléphones personnels. La vraie solution est de fournir un cadre clair :

→ Définir quels outils sont autorisés — et lesquels ne le sont pas.

→ Proposer une alternative professionnelle encadrée.

→ Former les équipes sur les bonnes pratiques.

→ Formaliser une politique d’utilisation de l’IA.

Le cabinet qui encadre l’IA protège ses clients. Celui qui l’ignore les expose.

Risque #5 — Attendre et ne rien faire

C’est le risque paradoxal. Et pourtant le plus courant.

Le coût de l’inaction

Sans stratégie, les collaborateurs utilisent quand même l’IA — mais sans cadre. C’est le risque #4 qui s’amplifie avec le temps.

Pendant ce temps, les organisations structurées prennent de l’avance. Le Thomson Reuters Institute (2025) le mesure : les organisations dotées d’une stratégie IA formelle sont deux fois plus susceptibles de voir leur activité croître.

Par où commencer

Cinq étapes suffisent pour poser un cadre solide :

- Identifier les tâches les plus chronophages : relances, synthèses, compilations.

- Évaluer les outils sur 3 critères : DPA, localisation des données, CLOUD Act.

- Formaliser une politique IA pour les équipes.

- Démarrer sur un périmètre maîtrisé : un type de dossier, un processus.

- Mesurer les résultats et élargir progressivement.

L’IA n’est pas un risque à éviter. C’est un risque à encadrer.

Comment choisir ? Synthèse comparative

Pour aider à la décision, voici les critères clés résumés.

Offres grand public (Free, Plus, Pro, Team)

| Critère | ChatGPT (OpenAI) | Claude (Anthropic) | Mistral AI |

|---|---|---|---|

| DPA conforme RGPD | ❌ Non | ❌ Non | ❌ Partiel |

| Soumis au CLOUD Act | ✅ Oui | ✅ Oui | ❌ Non |

| Données stockées en UE | ❌ Non (US) | ❌ Possible US | ✅ Oui (UE) |

| Entraînement sur données | ✅ Par défaut | ⚠️ Opt-in | ❌ Non (Pro) |

| Adapté données clients | ❌ Non | ❌ Non | ⚠️ Prudence |

Offres professionnelles (Enterprise, API)

| Critère | ChatGPT (OpenAI) | Claude (Anthropic) | Mistral AI |

|---|---|---|---|

| DPA conforme RGPD | ✅ Oui | ✅ Oui | ✅ Oui (Art. 28) |

| Soumis au CLOUD Act | ✅ Oui (atténuable) | ✅ Oui (atténuable) | ❌ Non |

| Données stockées en UE | ⚠️ Option Azure | ⚠️ Option AWS | ✅ Natif France |

| Entraînement sur données | ❌ Non | ❌ Non | ❌ Non |

| Adapté données clients | ✅ Avec cadre | ✅ Avec cadre | ✅ Souveraineté totale |

Le constat est factuel. Toutes les offres grand public présentent des lacunes pour des données clients. Les offres Enterprise sont conformes. Mais seul Mistral AI, entreprise française, échappe au CLOUD Act et garantit un hébergement européen natif.

L’alternative : une IA intégrée dans un cadre maîtrisé

Au-delà du choix du modèle, une troisième voie existe. Utiliser l’IA au sein d’une plateforme métier qui gère le cadre de sécurité pour vous.

C’est l’approche construite par ALF depuis 2024.

→ Le choix du modèle vous appartient. Mistral pour un hébergement 100% européen hors CLOUD Act. Ou ChatGPT, Claude, Gemini selon vos contraintes. C’est votre décision.

→ La non-utilisation pour l’entraînement est contractuelle. Ce n’est pas un paramètre à activer. C’est un engagement juridique.

→ L’IA comprend votre contexte. L’agent IA d’ALF accède à vos dossiers, aux bases légales (Legifrance, INSEE, BODACC) et à vos emails connectés.

→ Chaque action est tracée. Piste d’audit complète pour la conformité et la gouvernance.

→ Anonymisation by design. Vous définissez le périmètre des données accessibles à l’IA et contrôlez votre risque professionnel.

Le principe fondateur : l’IA suggère, le juriste décide. Toujours.

Et vous, qu’en pensez-vous ?

Vous êtes avocat, directeur juridique, expert-comptable, notaire ou commissaire aux comptes ? Vous exercez une profession réglementée où la confidentialité n’est pas une option ?

L’IA générative transforme nos métiers. C’est un fait. Mais les questions qu’elle soulève — secret professionnel, souveraineté des données, conformité — méritent un vrai débat entre professionnels.

Où en êtes-vous dans votre organisation ? Avez-vous défini un cadre ? Renoncé à l’IA par prudence ? Ou trouvé un équilibre qui fonctionne ?

Partagez votre expérience en commentaire. Ce sujet nous concerne tous.

FAQ

Un avocat peut-il utiliser une offre grand public d’IA pour des données clients ?

Non. Les offres Free, Plus, Pro et Team ne disposent pas de DPA conforme au RGPD. Les données peuvent servir à l’entraînement et être stockées hors UE. C’est incompatible avec le secret professionnel.

Quelle différence entre une offre « Pro » et une offre « Enterprise » ?

L’offre Pro est une offre grand public avec un nom trompeur. Pas de DPA, peu de garanties contractuelles. L’offre Enterprise intègre un DPA conforme, interdit l’entraînement et propose des options d’hébergement.

Mistral AI est-il vraiment à l’abri du CLOUD Act ?

Oui. Mistral AI est une société française de droit français. Elle n’est soumise ni au CLOUD Act, ni au FISA, ni à aucune loi extra-territoriale américaine.

Qu’est-ce que le Shadow IT dans le contexte de l’IA ?

C’est quand vos collaborateurs utilisent des outils IA avec leurs comptes personnels, sans validation ni cadre défini par l’organisation. Selon Thomson Reuters (2025), 78% des organisations juridiques n’ont pas de politique IA formelle.

Par où commencer pour encadrer l’IA ?

Identifiez vos tâches chronophages, évaluez les outils sur 3 critères (DPA, localisation, CLOUD Act), et formalisez une politique. Notre checklist gratuite couvre les 10 questions essentielles.

Vous voulez utiliser l’IA sans compromettre la confidentialité de vos dossiers ?

Prenons 30 minutes pour explorer vos enjeux. Pas de pitch commercial — un échange entre professionnels du droit pour voir comment encadrer l’IA dans votre quotidien.

Réserver un échange → askalf.com

SOURCES

Thomson Reuters Institute, Generative AI in Professional Services Report, 2025

Rapport juridique, Université de Cologne pour le ministère allemand de l’Intérieur, décembre 2025

CNIL, recommandations sur les transferts de données vers pays tiers

RGPD, Articles 28 et 48

Documentation officielle OpenAI, Anthropic et Mistral AI (DPA et conditions d’utilisation)

Auteur : Sabine Zylberbogen — CEO ALF, ex-Directrice Juridique Amazon France/Europe